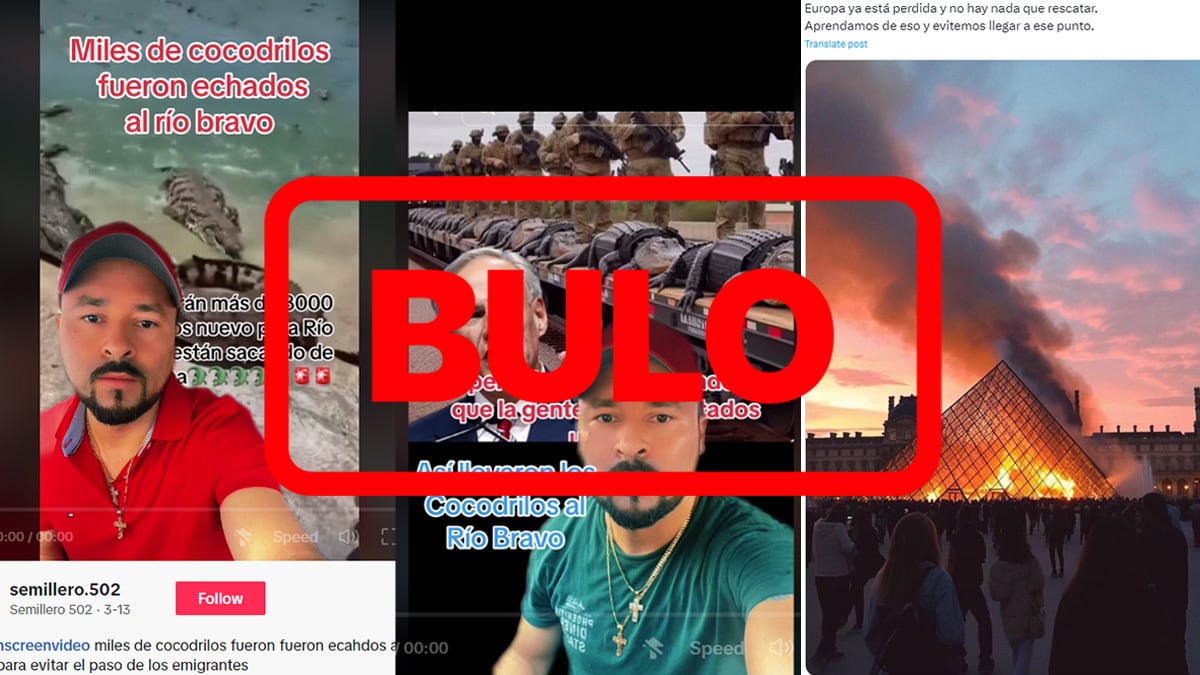

En la era de la hiperconectividad, la inteligencia artificial (IA) está generando una nueva ola de desinformación. A pesar de los intentos de gigantes tecnológicos como Google, Meta y OpenAI para detectar y marcar contenido generado por IA, las noticias falsas continúan circulando en las redes sociales. Rumores de que Estados Unidos ha liberado 8.000 cocodrilos en el Río Bravo para disuadir a los migrantes, o que la pirámide del Museo del Louvre se ha incendiado, son solo algunos ejemplos de la desinformación que se ha propagado recientemente. El desafío para los usuarios es discernir si las imágenes que ven en las redes sociales son reales o no.

Generar imágenes con inteligencia artificial se ha vuelto cada vez más fácil. Según Jeffrey McGregor, CEO de Truepic y uno de los fundadores de la Coalición para la Procedencia y Autenticidad del Contenido (C2PA), «Hoy en día cualquiera, sin ninguna habilidad técnica, puede escribir una oración en una plataforma como DALL-E, Firefly, Midjourney u otro modelo basado en mensajes y crear una pieza de contenido digital hiperrealista».

La IA tiene la capacidad de crear imágenes increíblemente realistas de personas o eventos que nunca sucedieron, lo que puede ser utilizado para influir en las opiniones, dañar la reputación de alguien, crear desinformación y proporcionar un contexto falso en torno a situaciones reales.

Las herramientas de IA también pueden ser utilizadas para representar falsamente a personas en posiciones comprometedoras, cometiendo delitos o acompañadas de delincuentes. Según V.S. Subrahmanian, profesor de informática en la Universidad Northwestern, «Estas imágenes se pueden usar para extorsionar, chantajear y destruir la vida de líderes y ciudadanos comunes».

Más aún, las imágenes generadas por IA pueden representar una grave amenaza para la seguridad nacional. Josep Albors, director de investigación y concienciación de la compañía de seguridad informática ESET en España, explica que muchos bulos se basan en este tipo de imágenes para generar controversia y provocar reacciones.

Para combatir esta amenaza, expertos como Albors aconsejan adoptar una actitud de sospecha en el mundo online. Saber que una imagen puede haber sido generada por IA es un paso crucial para evitar ser engañados y compartir desinformación.

Detectar imágenes generadas con IA puede ser un desafío, pero existen algunas pistas que pueden ayudar en el proceso. Jonnathan Pulla, un verificador de hechos de Factchequeado, sugiere prestar atención a los detalles de las manos, los ojos o los rostros en las imágenes.

Para ayudar a identificar imágenes falsas, existen herramientas como AI or NOT, Sensity, FotoForensics o Hive Moderation. OpenAI también está desarrollando su propia herramienta para detectar contenido creado por su generador de imágenes, DALL-E. Sin embargo, estas herramientas no son infalibles y deben ser utilizadas en combinación con otras técnicas de verificación.

El problema principal de estas herramientas es que carecen de contexto y conocimientos previos. Según Subrahmanian, «Los humanos utilizan su sentido común todo el tiempo para separar las afirmaciones reales de las falsas, pero los algoritmos de aprendizaje automático para la detección de imágenes deepfake han avanzado poco en este sentido».

Además de los píxeles manipulados, también puede ser casi imposible identificar si los metadatos de una imagen —la hora, la fecha y la ubicación— son precisos después de su creación. McGregor considera que «la procedencia del contenido digital, que utiliza criptografía para marcar imágenes, será la mejor manera para que los usuarios identifiquen en el futuro qué imágenes son originales y no han sido modificadas».

Hasta que estos sistemas estén ampliamente implementados, es fundamental que los usuarios adopten una postura crítica. Como afirma Tamoa Calzadilla, editora jefa de Factchequeado, «La verificación se realiza mediante varias técnicas: la observación, el uso de herramientas y las clásicas del periodismo. Es decir, contactar con la fuente original, revisar sus redes sociales y verificar si la información que se le atribuye es cierta».