En lo que parece ser un inesperado giro de los acontecimientos, Microsoft se enfrenta a una crisis de reputación debido a la reciente presentación de la función Recall en sus Copilot+ PC. En lugar de ser el revolucionario «game changer» que la empresa esperaba, la función parece haber abierto la puerta a serios problemas de privacidad.

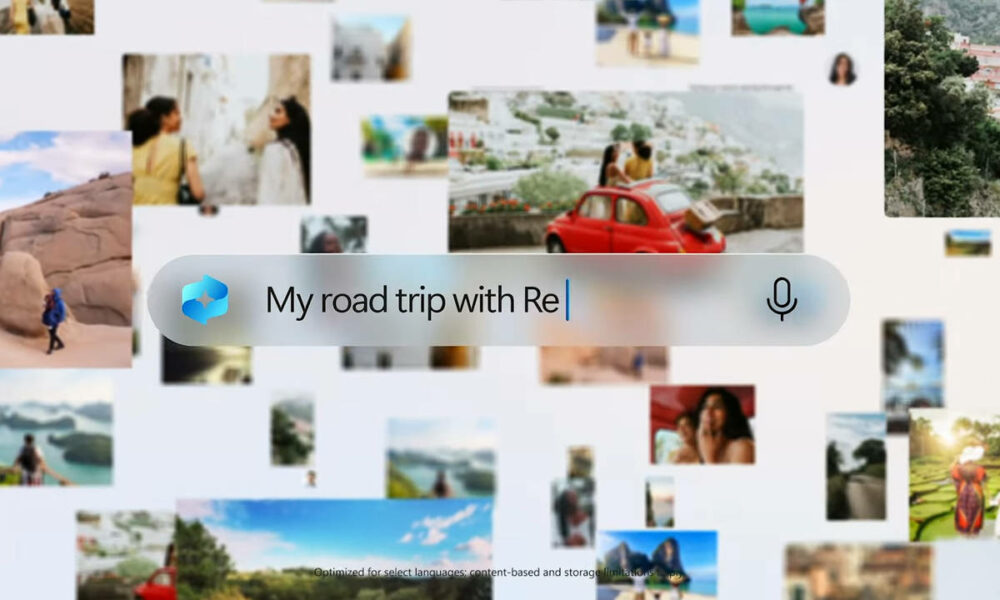

Recall fue presentada como una memoria fotográfica, un concepto que Microsoft esperaba que se asociara con esta función, evocando comparaciones con el «Grano» del episodio «The Entire History of You» de la serie de televisión Black Mirror. Sin embargo, menos de 24 horas después de su presentación, el concepto de «pesadilla para la privacidad» comenzó a difundirse rápidamente, una etiqueta que lamentablemente se confirmó con las deficiencias posteriores de la función.

Microsoft inicialmente planeaba que Recall estuviera disponible en una versión de vista previa a partir del 18 de junio, coincidiendo con la llegada al mercado de los primeros equipos Copilot+ PC. La función se activaría de forma predeterminada en todos los nuevos sistemas. Sin embargo, en un giro afortunado de los acontecimientos, Microsoft ha dado marcha atrás en esta decisión. También se ha retirado una versión previa de Windows 11 para insiders que incluía Recall y se ha añadido un nuevo apartado en la configuración del sistema que permite desactivar todas las funciones de IA generativa de Microsoft. Estas tres decisiones son reacciones positivas a la situación, en mi opinión.

Ahora, parece que Microsoft ha decidido actuar con cautela. Recall no estará disponible de manera general en los PC con Windows 11 ARM a partir del 18 de junio. En su lugar, la función se liberará unas semanas más tarde solo para los insiders. Tras recopilar todo el feedback necesario, afirman, llegará el momento de empezar a desplegarlo para todos los usuarios con ordenadores compatibles.

En una semana, hemos pasado de un despliegue inminente y la activación por defecto, a una evaluación mucho más sosegada, un despliegue progresivo con una primera fase para los insiders y, además, a que sea necesario activarlo para que Recall empiece a recopilar información. Sin duda, nos encontramos ante una rectificación clara y sin ambages, con una actitud mucho más defendible.

Con todo esto en mente, uno no puede evitar preguntarse: ¿qué habría pasado si Microsoft hubiera actuado de esta manera desde el primer momento? ¿Podría haberse evitado la crisis de reputación que ahora afronta la empresa? No hay una respuesta clara a estas preguntas, pero lo que sí es seguro es que este incidente debería servir como una lección para todas las empresas que buscan innovar en el campo de la inteligencia artificial.

La IA tiene un enorme potencial, pero también plantea serios desafíos en cuanto a privacidad y seguridad. Las empresas deben ser conscientes de estos riesgos y tomar todas las precauciones necesarias para proteger a sus usuarios. En este sentido, la decisión de Microsoft de retrasar el despliegue de Recall y permitir a los usuarios desactivar sus funciones de IA es un paso en la dirección correcta.

En un mundo cada vez más digitalizado, la privacidad y la seguridad son más importantes que nunca. Las empresas no pueden permitirse el lujo de ignorar estos aspectos en su búsqueda de innovación. Esperemos que Microsoft y otras empresas tomen nota de este incidente y sigan avanzando en la creación de tecnologías seguras y respetuosas con la privacidad.

En resumen, el incidente de Microsoft con Recall es un claro ejemplo de los desafíos que pueden surgir en el desarrollo y despliegue de nuevas tecnologías basadas en IA. Aunque la innovación es importante, la privacidad y la seguridad de los usuarios no deben ser sacrificadas en su nombre. En lugar de precipitarse en el despliegue de nuevas funciones, las empresas deben tomar el tiempo necesario para evaluar sus posibles implicaciones y garantizar que se toman todas las medidas necesarias para proteger a los usuarios.